»

Wenn es überhaupt etwas gibt, was die „AG Energetik“ in ihrer nunmehr bald 5-jährigen Geschichte ein Stück weiterentwickelt hat, dann ist es eindeutig das Konzept des EROI. Nicht umsonst wurde ich schon mal „Mr. EROI“ genannt  , was ich jedoch nur deshalb erwähnen möchte, weil diese Zuschreibung klar ironisch gemeint war und insofern keine Gefahr besteht, eine Menge dicke Luft zu produzieren…😳

, was ich jedoch nur deshalb erwähnen möchte, weil diese Zuschreibung klar ironisch gemeint war und insofern keine Gefahr besteht, eine Menge dicke Luft zu produzieren…😳

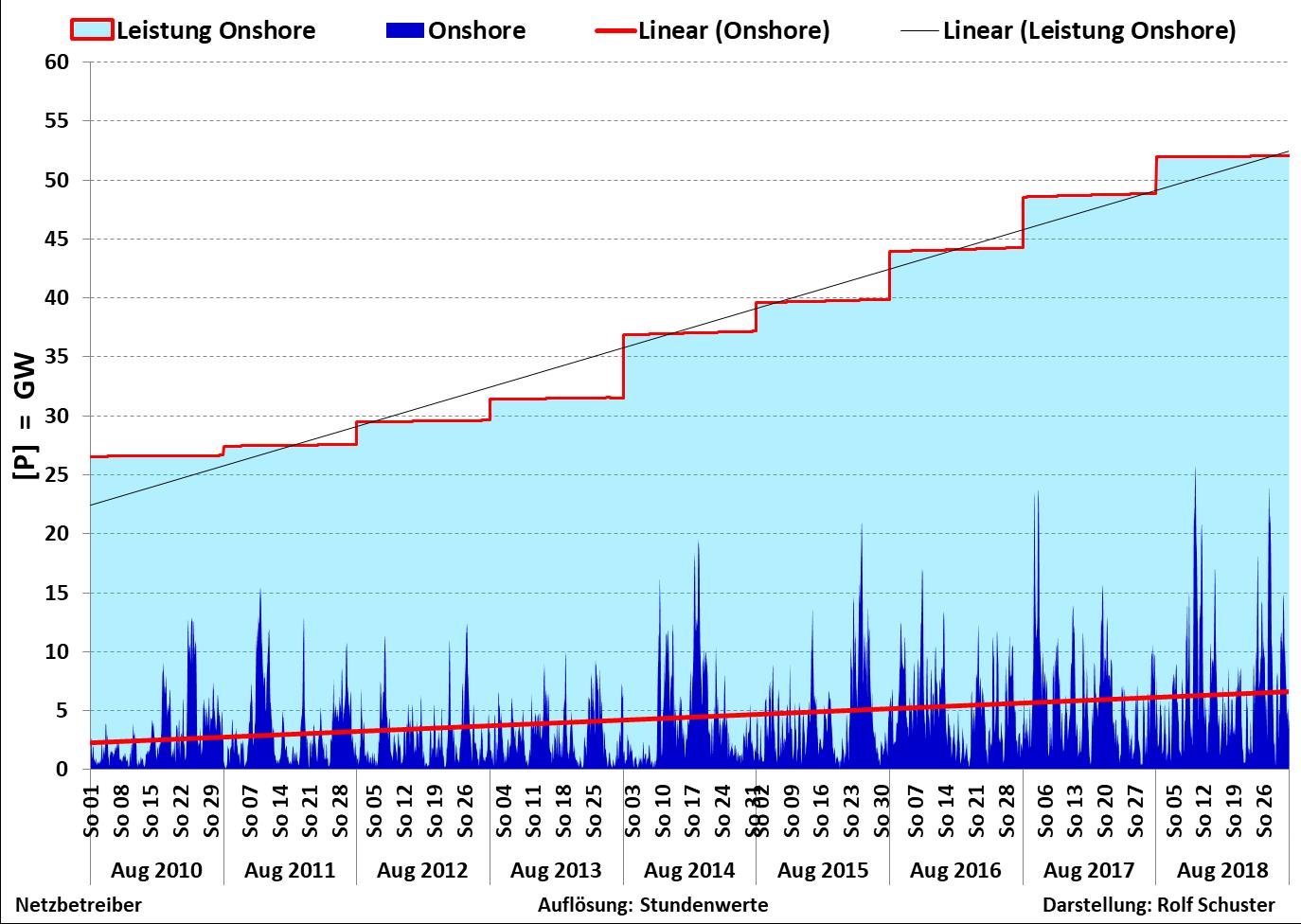

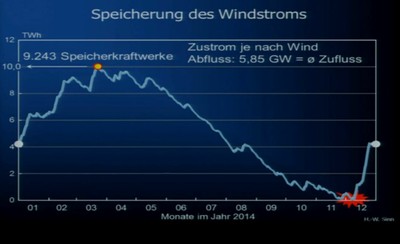

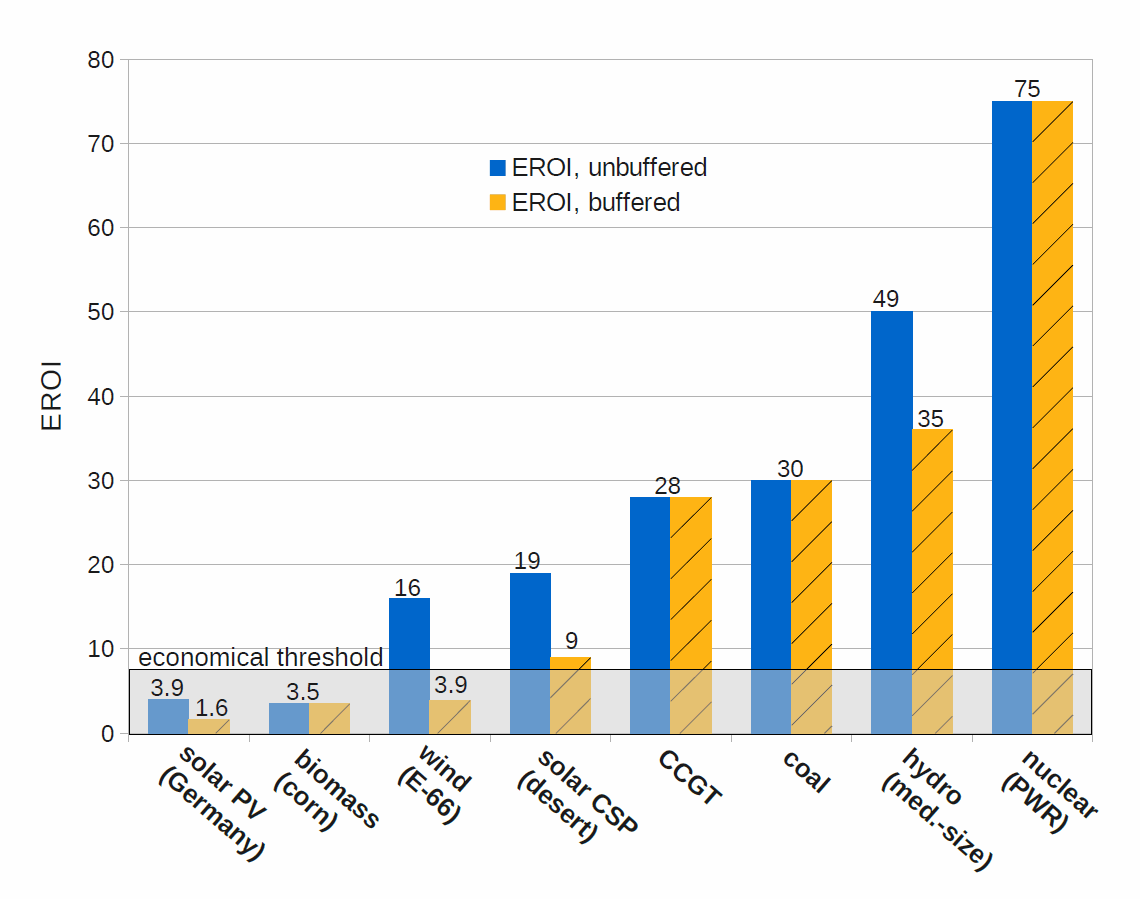

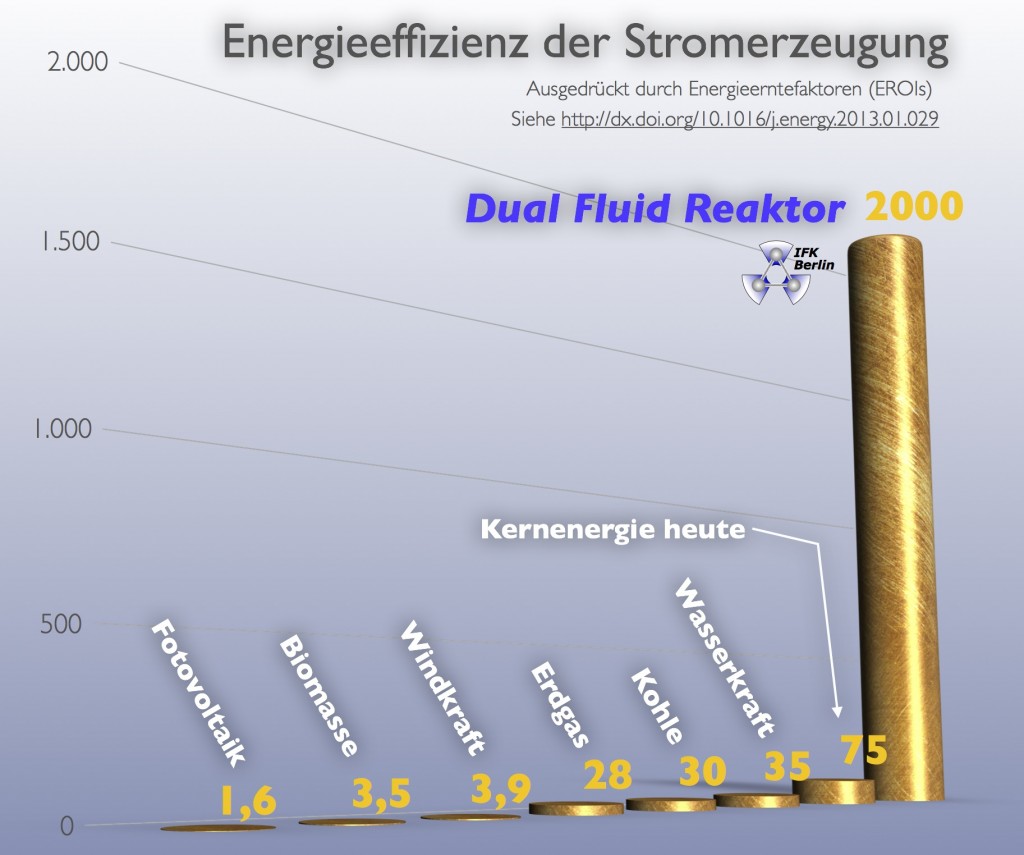

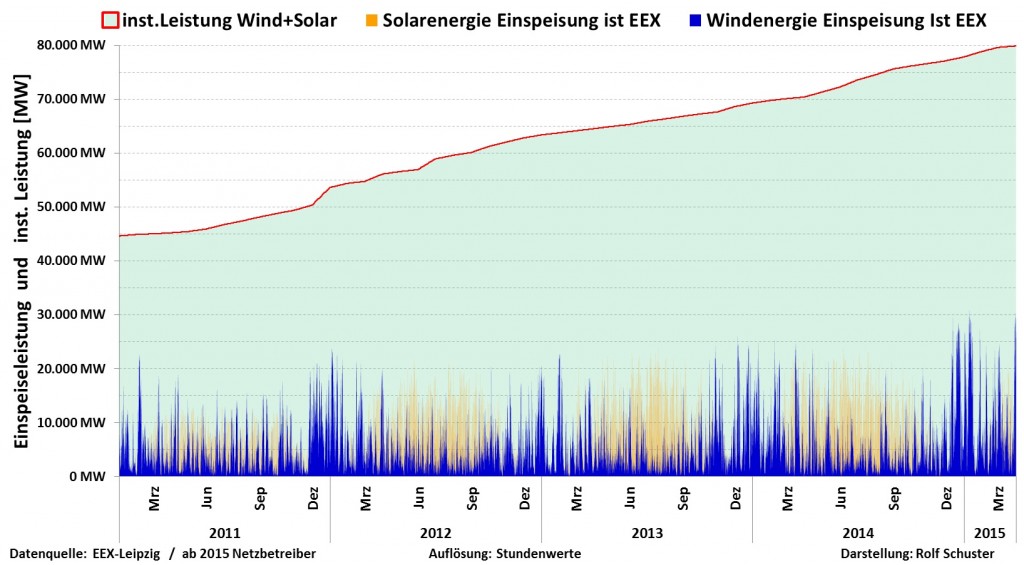

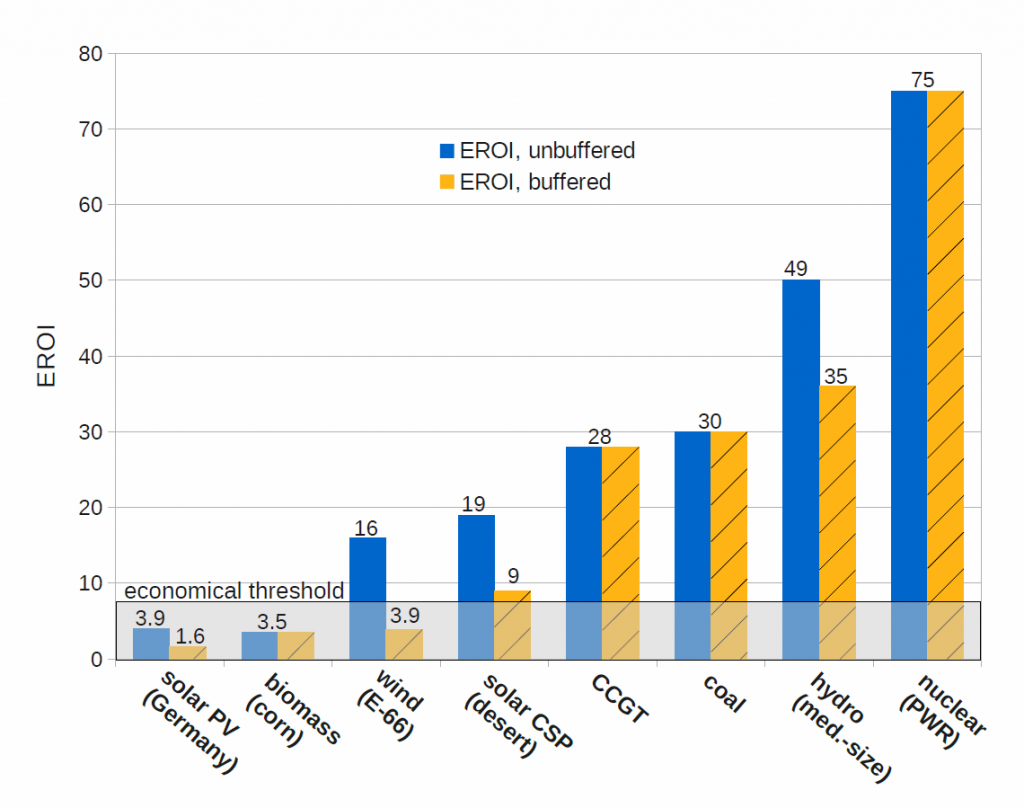

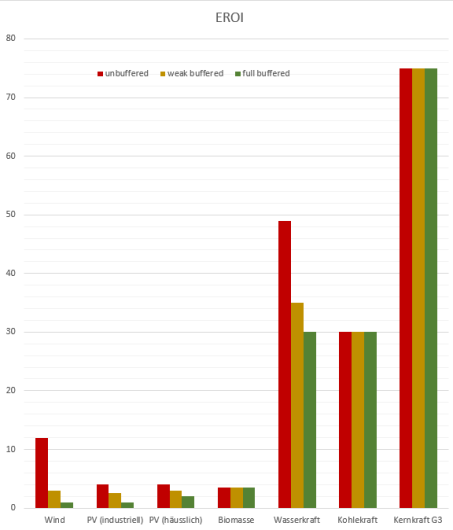

Jedenfalls haben all unsere ➡ AG’s eben zum Thema EROI eine Menge erforscht und interessante Resultate erarbeitet. So haben wir Methoden einer heuristischen Ermittlung des EROI am Beispiel der Offshoreparks „alpha-ventus“ sowie „Amrumbank West“ (Teil1, Teil2) kennengelernt und dabei den Pufferungs-Koeffizienten postuliert. Dieses ![]() haben wir dann im Rahmen der beiden AG’s über den χ- (Chi-) sowie den κ- (Kappa)-Effekt auf Fluxionsverhalten untersucht und dabei Abflachungs- bis Sättigungs-Effekte festgestellt. All das sind doch Erkenntnisse, die – so sie denn von den Entscheidern in Politik und Wirtschaft beherzigt worden wären – uns jede Menge Unheil hätten ersparen können.

haben wir dann im Rahmen der beiden AG’s über den χ- (Chi-) sowie den κ- (Kappa)-Effekt auf Fluxionsverhalten untersucht und dabei Abflachungs- bis Sättigungs-Effekte festgestellt. All das sind doch Erkenntnisse, die – so sie denn von den Entscheidern in Politik und Wirtschaft beherzigt worden wären – uns jede Menge Unheil hätten ersparen können.

Dennoch, bei all der bescheidenen Kompetenz in Sachen EROI, räume ich freimütig ein, dass diese Kennzahl nicht alles ist. Denn was der EROI definitorisch beschreibt, ist die Beanspruchung von energetischen Ressourcen einer Anlage, z.B. eines Kraftwerks, im (umgekehrten) Verhältnis zu der am Ende gewonnenen Nutzenergie. Hingegen, was hier allenfalls nur partiell erfasst wird, ist die Beanspruchung von natürlichen Ressourcen ➡ bei dem Gestehungsprozess; wir nennen es kurz und bündig „Impact“.

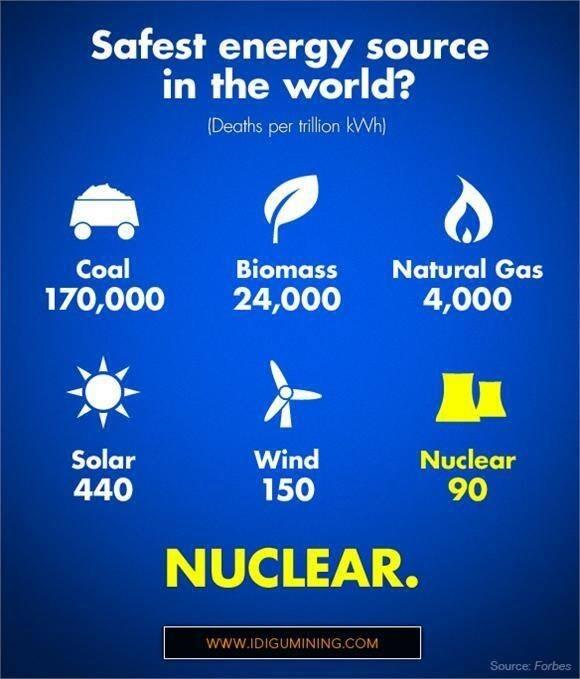

➡ bereits in einem alten Blogbeitrag https://stawarz.de/?p=217 im Frühjahr 2012 unter der Überschrift „the-END Studie“ („END“ stand für „Energiewende? Nein, Danke“) machte ich mir Gedanken über die Beanspruchung bzw. Verbrauch von natürlichen Ressourcen energetischer Anlagen, also Kraftwerke, Energiespeicher etc. Damals postulierte ich – in Anlehnung an die volumetrische bzw. gravimetrische Energiedichte bei den Energiespeichern – den Begriff der „ökometrischen Energiedichte“. Das war der erste Versuch den Impact ins Verhältnis zu dem Nutzen, etwa der Energieernte, zu setzen. In einer nachgeschalteten Studie »Impact „Erneuerbarer Energien“ in die Biosphäre« https://stawarz.de/?p=1166 versuchte ich den Impact an der statistischen Anzahl der Todesopfer (bezogen auf kWh Energiegewinn) festzumachen; dazu gleich mehr.

➡ bereits in einem alten Blogbeitrag https://stawarz.de/?p=217 im Frühjahr 2012 unter der Überschrift „the-END Studie“ („END“ stand für „Energiewende? Nein, Danke“) machte ich mir Gedanken über die Beanspruchung bzw. Verbrauch von natürlichen Ressourcen energetischer Anlagen, also Kraftwerke, Energiespeicher etc. Damals postulierte ich – in Anlehnung an die volumetrische bzw. gravimetrische Energiedichte bei den Energiespeichern – den Begriff der „ökometrischen Energiedichte“. Das war der erste Versuch den Impact ins Verhältnis zu dem Nutzen, etwa der Energieernte, zu setzen. In einer nachgeschalteten Studie »Impact „Erneuerbarer Energien“ in die Biosphäre« https://stawarz.de/?p=1166 versuchte ich den Impact an der statistischen Anzahl der Todesopfer (bezogen auf kWh Energiegewinn) festzumachen; dazu gleich mehr.

.

Betrachten wir zunächst einmal eine WKA auf der einen und eine PV auf der anderen Seite. Der EROI ist – egal wie gerechnet – stets 1-stellig, also von der gleichen Größenordnung, und dennoch ist der Impact offensichtlich diametral unterschiedlich. Denn die PV-Anlage auf dem Dach stört niemanden, die im Solarpark schon eher, aber auch nicht so arg – während alleine das monströse WKA-Fundament aus mehreren Tausend t Stahlbeton einen verheerenden Eingriff in die Natur darstellt. Ein anderer Vergleich gilt einem Kohlekraftwerk gegenüber einem Kernkraftwerk. Auch hier sind die EROI in beiden Fällen vergleichbar und dennoch unterscheidet sich die Statistik der Todesopfer gleich um mehrere Größenordnungen.

Betrachten wir zunächst einmal eine WKA auf der einen und eine PV auf der anderen Seite. Der EROI ist – egal wie gerechnet – stets 1-stellig, also von der gleichen Größenordnung, und dennoch ist der Impact offensichtlich diametral unterschiedlich. Denn die PV-Anlage auf dem Dach stört niemanden, die im Solarpark schon eher, aber auch nicht so arg – während alleine das monströse WKA-Fundament aus mehreren Tausend t Stahlbeton einen verheerenden Eingriff in die Natur darstellt. Ein anderer Vergleich gilt einem Kohlekraftwerk gegenüber einem Kernkraftwerk. Auch hier sind die EROI in beiden Fällen vergleichbar und dennoch unterscheidet sich die Statistik der Todesopfer gleich um mehrere Größenordnungen.

Beide Beispiele zeigen, dass der Impact über den EROI hinaus mindestens zwei weitere Komponenten zu haben scheint und zwar die ökometrische Energiedichte auf der einen sowie die „Deaths per PWh“ auf der anderen Seite. Was wir nun innerhalb dieser AG versuchen wollen, ist beide Komponenten energetisch zu quantifizieren.

Die Frage, die wir uns im ersteren der beiden Fälle stellen, lautet schlicht, wieviel Energie aufzuwenden wäre, um all die Schäden an der Umwelt – ob nun dauerhaft oder nicht – auszugleichen? Das ist noch unproblematisch, das kann man mit Fug und Recht fragen. Jedoch bei der 2. Komponente beginnt schon die erste ethische Problematik… Denn kann man bei den „Deaths per PWh“ guten Gewissens energetische (oder gar monetäre…😳) Äquivalente fürs menschliche Leben angeben? Nein, so unreflektiert sicher nicht! Auf der anderen Seite dürfte es noch schlimmer und menschenverachtender werden, dies völlig außer Betracht zu lassen. Dann halte ich doch mehr davon, es doch zu quantifizieren, dafür aber mit dem gebührenden Wert. Daher versehen wir den EROI mit einem Korrekturfaktor ![]() wie folgt:

wie folgt:

![]()

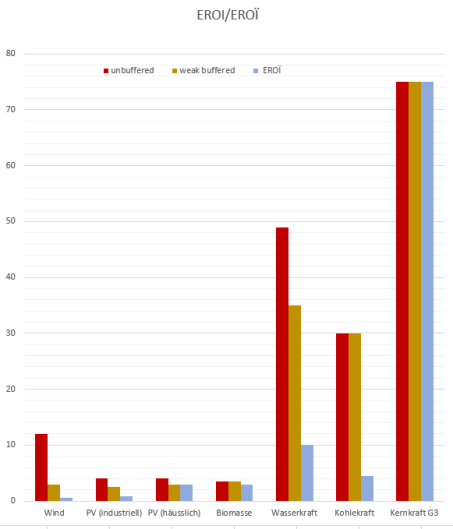

EROÏ – Energy Return of Invested Impact. Die AG

.

Et voilà! Zunächst, was das ethisch nicht unproblematische ![]() anbelangt, so ist die Sache wenigstens von der Arithmetik her gesehen trivial. Natürlich haben wir hier den Umrechnungsfaktor willkürlich auf 1:200.000 gesetzt, aber dies gilt nun einmal für alle Energien gleichermaßen. Klar ist, dass es auch andere Statistiken „how deadly is your kWh“ gibt, die bei diesem Umrechnungsfaktor zu merkwürdigen Ergebnissen geführt hätten. Allerdings beträfe dies wie gesagt alle Energien gleichermaßen, so dass sich hier keinerlei Bevorzugungen oder Benachteiligungen für oder gegen die eine oder andere Energieform herleiten lassen.

anbelangt, so ist die Sache wenigstens von der Arithmetik her gesehen trivial. Natürlich haben wir hier den Umrechnungsfaktor willkürlich auf 1:200.000 gesetzt, aber dies gilt nun einmal für alle Energien gleichermaßen. Klar ist, dass es auch andere Statistiken „how deadly is your kWh“ gibt, die bei diesem Umrechnungsfaktor zu merkwürdigen Ergebnissen geführt hätten. Allerdings beträfe dies wie gesagt alle Energien gleichermaßen, so dass sich hier keinerlei Bevorzugungen oder Benachteiligungen für oder gegen die eine oder andere Energieform herleiten lassen.

Was hier quasi vorneweg ganz besonders bös erwischt wird, ist eindeutig die Kohle, bei der das ![]() sage und schreibe 0.15 beträgt, was den EROÏ auf 4.5 absacken lässt 👿. Die Befürworter des Kohleausstiegs können also jubeln… während bei der Biomasse wie bei Wasserkraft die Korrektur mit einem

sage und schreibe 0.15 beträgt, was den EROÏ auf 4.5 absacken lässt 👿. Die Befürworter des Kohleausstiegs können also jubeln… während bei der Biomasse wie bei Wasserkraft die Korrektur mit einem ![]() von je etwa 0.88 eher noch überschaubar bleibt. Bei den Erneuerbaren ➡ – und erst recht bei der Kernkraft – beträgt das

von je etwa 0.88 eher noch überschaubar bleibt. Bei den Erneuerbaren ➡ – und erst recht bei der Kernkraft – beträgt das ![]() beinahe 1, ist also in diesem Zusammenhang vollkommen irrelevant.

beinahe 1, ist also in diesem Zusammenhang vollkommen irrelevant.

Bei dem 2. Term, wo das ![]() drin steckt, wird die Sache hingegen ein Bit komplizierter. Zunächst müssen wir wohl auch hier einen Umrechnungsfaktor ansetzen, nicht zuletzt deshalb, weil auch das

drin steckt, wird die Sache hingegen ein Bit komplizierter. Zunächst müssen wir wohl auch hier einen Umrechnungsfaktor ansetzen, nicht zuletzt deshalb, weil auch das ![]() eine dimensionslose Größe bleiben muss. Die Frage, die wir uns nun stellen müssen, lautet, wie können wir dimensionslos den Bedarf an natürlichen Ressourcen via ökometrische Energiedichte beziffern? Wir schlagen vor, den „normalen“ Flächenbedarf eines Kraftwerks schlicht ins Verhältnis zur durchschnittlichen Leistung zu setzen; auch hier ist der Umrechnungsfaktor 1:50 [km2/MW] willkürlich gewählt.

eine dimensionslose Größe bleiben muss. Die Frage, die wir uns nun stellen müssen, lautet, wie können wir dimensionslos den Bedarf an natürlichen Ressourcen via ökometrische Energiedichte beziffern? Wir schlagen vor, den „normalen“ Flächenbedarf eines Kraftwerks schlicht ins Verhältnis zur durchschnittlichen Leistung zu setzen; auch hier ist der Umrechnungsfaktor 1:50 [km2/MW] willkürlich gewählt.

➡ Wir wissen nicht zuletzt aus der AG »Impact „Erneuerbarer Energien“ in die Biosphäre« vom Oktober 2015, dass die „Deaths-per-PWh“-Statistiken für Erneuerbare nicht vollständig sind. Sie berücksichtigen insbesondere nicht die Abhängigkeit qua EROI von der wesentlich tödlicheren Kohle. Aber gnädig wie wir nun mal sind  , wollen wir dies hier zugunsten der EE außer Betracht lassen.

, wollen wir dies hier zugunsten der EE außer Betracht lassen.

.

Wir setzen also an ![]() .

.

Zunächst sehen wir auf Anhieb, dass die thermischen Kraftwerke – also Kohle-, Gas-, Biomasse-, Kernkraftwerke – hiervon quasi unberührt bleiben. Denn bei einer Leistung von mehreren Hundert Megawatt aus nur einigen Quadratkilometern resultiert eine sehr hohe Energiedichte, die im Kehrwert ≈1 ergibt.

Die Sache beginnt sich jedoch im Falle der Wasserkraft langsam zu relativieren. Denn je nach dem, was man alles zu der beanspruchten Fläche zählt – etwa die versiegelte Fläche, die Staudämme etc. – kommt man bei nur einigen Megawatt Leistung u.U. auf durchaus relevante Korrekturfaktoren. So errechneten wir für Wasserkraft einen Korrekturfaktor ![]() von 0.4, was den EROÏ auf 10 absacken lässt.

von 0.4, was den EROÏ auf 10 absacken lässt.

Bei der Fotovoltaik müssen wir indes aufpassen. Die Fläche, die ein Solarpark beispielsweise beansprucht, ist klar und einfach quantifizierbar. Allerdings ist es im Falle einer häuslichen PV-Anlage auf dem Dach nicht mehr so einfach, denn diese Fläche, zwar physikalisch einwandfrei beansprucht, war ohnehin als Nutzfläche verloren. Anders ausgedrückt, der Impact, der hieraus resultiert, ist praktisch Null.

Zu guter Letzt erlebt die Windkraft – ob Offshore oder Onshore – einen wahren Super-GAU in diesem Zusammenhang. Denn angewandt beispielsweise auf den Vorzeige-Offshore-Windpark Amrumbank West, mit 3,5 MW durchschnittlicher Leistung aus 35 km2 Fläche ergibt sich ein ![]() von 5, was den EROÏ weit unter 1 absacken lässt. Windkraft ist somit nicht nur gefühlt die mit dem allerhöchsten Impact verbundene Energieform.

von 5, was den EROÏ weit unter 1 absacken lässt. Windkraft ist somit nicht nur gefühlt die mit dem allerhöchsten Impact verbundene Energieform.